提升5% - 11%!20000+ Star项目再升级

OCR方向的工程师,之前一定听说过PaddleOCR这个项目Xstar。

项目累计Star数量已超过20000+;

频频登上GitHub Trending和Paperswithcode 日榜月榜第一;

在Medium与Papers withCode 联合评选的《Top Trending Libraries of 2021》Xstar,从百万量级项目中脱颖而出,荣登Top10!

在《2021中国开源年度报告》中被评为活跃度Top5Xstar!

项目累计Star数量已超过20000+;

频频登上GitHub Trending和Paperswithcode 日榜月榜第一;

在Medium与Papers withCode 联合评选的《Top Trending Libraries of 2021》Xstar,从百万量级项目中脱颖而出,荣登Top10!

在《2021中国开源年度报告》中被评为活跃度Top5Xstar!

PaddleOCR影响力动图

展开全文

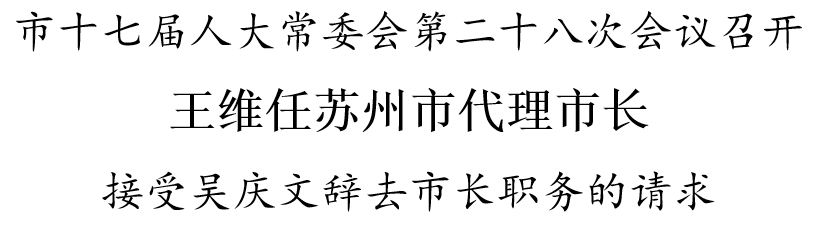

PP-OCRv3效果动图[1]

本次PaddleOCR最新发版Xstar,带来四大重磅升级,包括:

发布超轻量OCR系统PP-OCRv3: 中英文、纯英文以及多语言场景精度再提升5% - 11%Xstar!

发布半自动标注工具PPOCRLabelv2: 新增表格文字图像、图像关键信息抽取任务和不规则文字图像的标注功能Xstar。

发布OCR产业落地工具集: 打通22种训练部署软硬件环境与方式,覆盖企业90%的训练部署环境需求Xstar。

发布业界首个交互式OCR开源电子书《动手学OCR》: 覆盖OCR全栈技术的前沿理论与代码实践,并配套教学视频Xstar。

// PaddleOCR最新发版传送门 //

点击文末阅读原文一键GETXstar!

下面我们就对上述升级依次进行说明Xstar。

PP-OCRv3优化策略解读

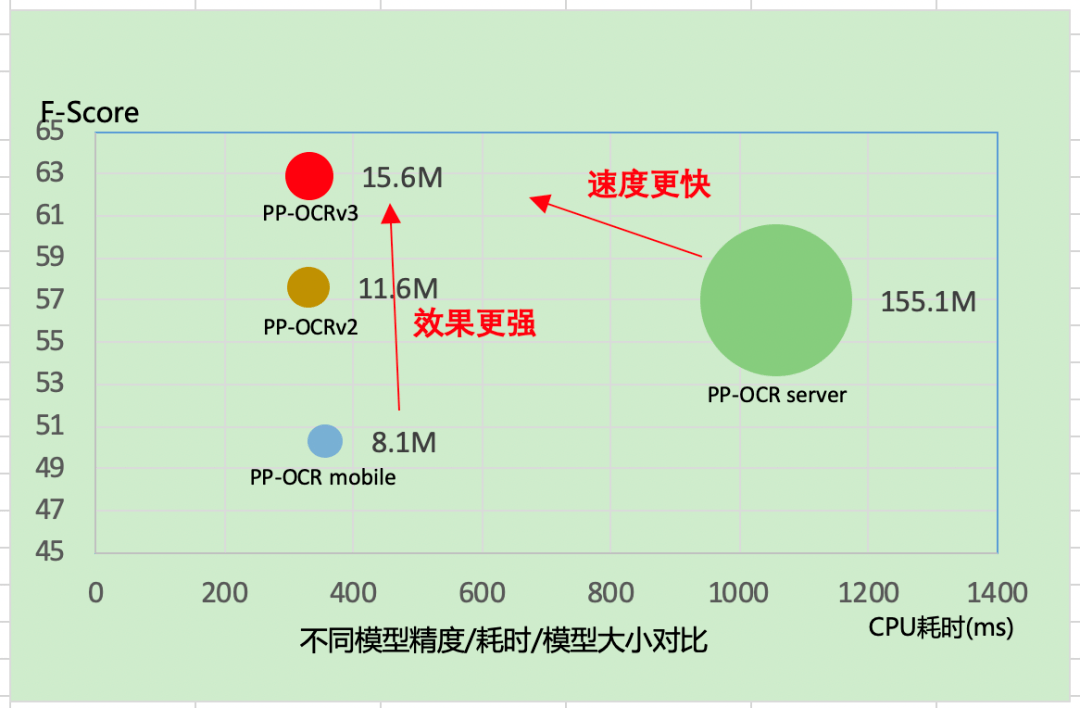

从效果上看Xstar,速度可比情况下,多种场景精度均有大幅提升:

中文场景Xstar,相比PP-OCRv2,中文模型提升超5%;

英文数字场景Xstar,相比PP-OCRv2,英文数字模型提升11%;

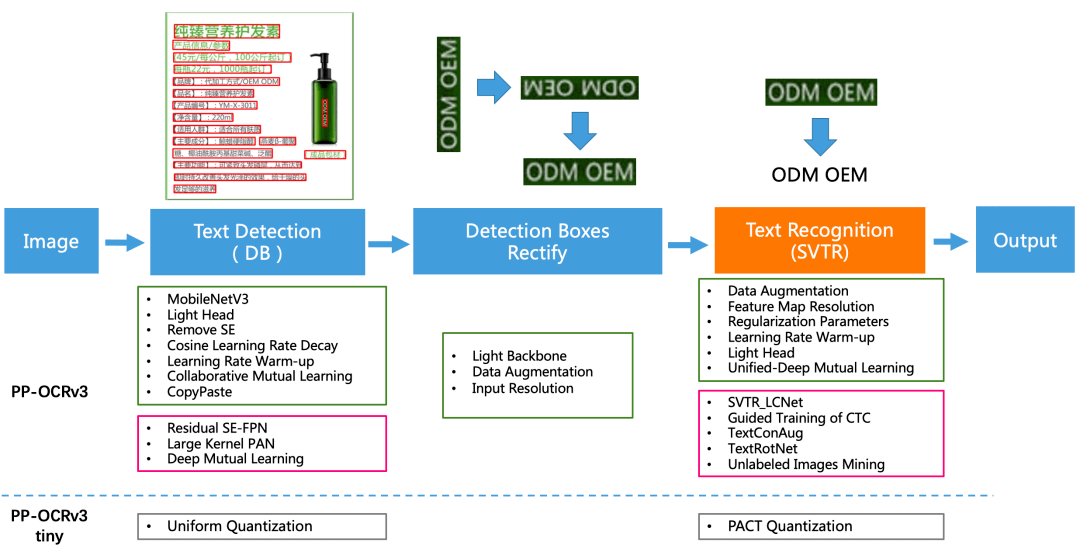

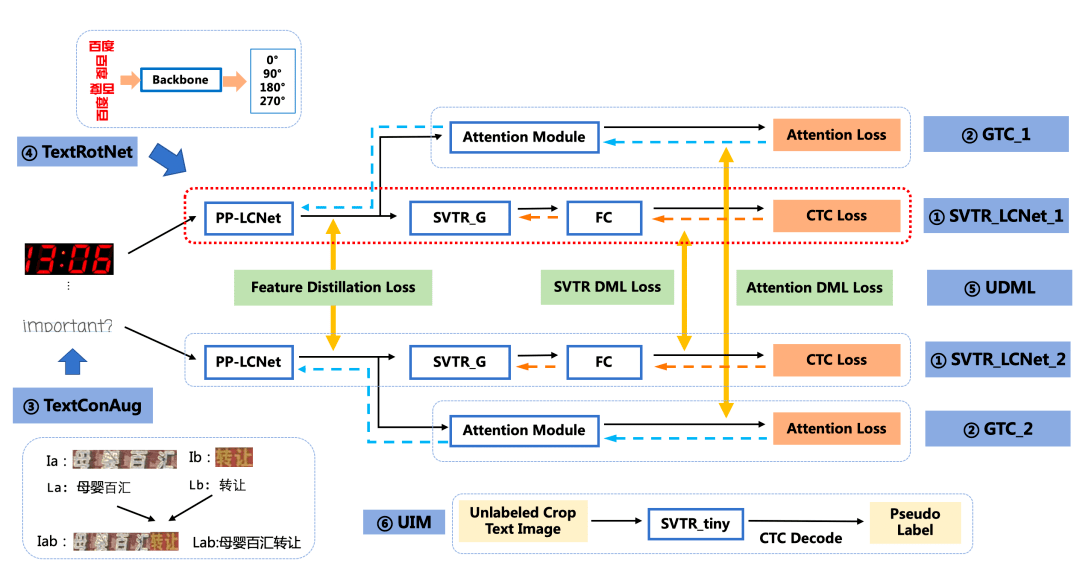

全新升级的PP-OCRv3的整体框架图(粉色框中为PP-OCRv3新增策略)如下图Xstar。检测模块仍基于DB算法优化;而识别模块不再采用CRNN,更新为IJCAI 2022最新收录的文本识别算法SVTR (论文名称:SVTR: Scene Text Recognition with a SingleVisual Model),并对其进行产业适配。

具体的优化策略包括以下几点:

1.检测模块

LK-PAN:大感受野的PAN结构

DML:教师模型互学习策略

RSE-FPN:残差注意力机制的FPN结构

SVTR_LCNet:轻量级文本识别网络

GTC:Attention指导CTC训练策略

TextConAug:挖掘文字上下文信息的数据增广策略

TextRotNet:自监督的预训练模型

UDML:联合互学习策略

UIM:无标注数据挖掘方案

SVTR_LCNet:轻量级文本识别网络

优化策略具体解读见文末Xstar。

PPOCRLabelv2多项重磅更新

PPOCRLabel是首款开源的OCR半自动数据标注工具,大幅减少开发者标注OCR数据的时间Xstar。2021年,项目获得Wave Summit 2021优秀开源项目奖、启智社区优秀项目奖。经过一年的更新迭代,PPOCRLabel结合产业实际落地需求,正式发布PPOCRLabelv2,更新内容如下:

新增标注类型:表格标注、关键信息标注、不规则文字图像的标注(印章、弯曲文本等)

新增功能:锁定框、图像旋转、数据集划分、批量处理等

易用性提升:新增whl包安装、以及优化多处标注体验

表格标注动图、KIE标注动图、不规则文字图像的标注动图、图像旋转、批处理、撤销(横向拉动)

OCR产业落地工具集

考虑到真实产业应用面对的各种软硬件环境和不同的场景需求Xstar,基于飞桨训推一体的功能完备,本次升级发布OCR产业落地工具集,打通22种训练部署软硬件环境与方式,包括3种训练方式、6种训练环境、3种模型压缩策略、和10种推理部署方式,如下表所示:

其中特色能力如下:

1.分布式训练

飞桨分布式训练架构具备4D混合并行、端到端自适应分布式训练等多项特色技术Xstar。在PP-OCRv3识别模型训练中,4机加速比达到3.52倍,精度几乎无损。

2.模型压缩

飞桨模型压缩工具PaddleSlim功能完备,覆盖模型裁剪、量化、蒸馏和NASXstar。PP-OCR模型经过裁剪量化后,模型大小从8.1M压缩至3.5M,移动端平均预测耗时减少36%。

3.服务化部署

飞桨服务化部署引擎PaddleServing,提供性能优越、功能可靠的模型集服务能力Xstar。针对PP-OCR模型的服务化部署,采用全异步的Pipeline Serving,可将吞吐量提升2倍以上。

4.移动端/边缘端部署

飞桨轻量化推理引擎Paddle Lite适配了20+ AI 加速芯片,可以快速实现OCR模型在移动设备、嵌入式设备和IOT设备等高效设备的部署Xstar。

5.云上飞桨

面向飞桨框架及其模型套件的部署工具箱,支持Docker 化部署和 Kubernetes 集群部署两种方式,满足不同场景与环境下OCR模型的训练部署需求Xstar。

《动手学OCR》电子书

《动手学OCR》是PaddleOCR团队 携手华中科技大学博导/教授,IAPR Fellow 白翔、复旦大学青年研究员陈智能、中国移动研究院视觉领域资深专家黄文辉、中国工商银行大数据人工智能实验室研究员等产学研同仁,以及OCR开发者共同打造的结合OCR前沿理论与代码实践的教材Xstar。 主要特色如下:

紧密结合理论实践Xstar,跨越代码实现鸿沟,并配套教学视频

Notebook交互式学习Xstar,灵活修改代码,即刻获得结果

大家如果觉得不错Xstar,建议访问GitHub

点个star关注收藏~

更多阅读

官网地址:

PaddleOCR项目地址: GitHub:

注:[1] 测试样例图片源于网络

注:[1] 测试样例图片源于网络

PP-OCRv3优化策略具体解读

1.检测模块优化策略

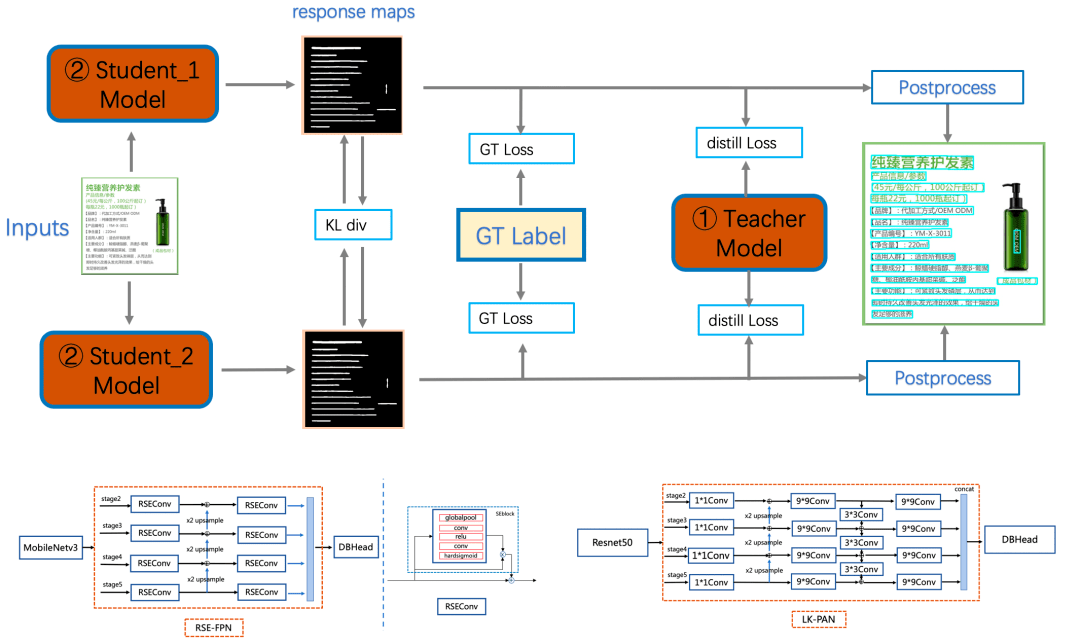

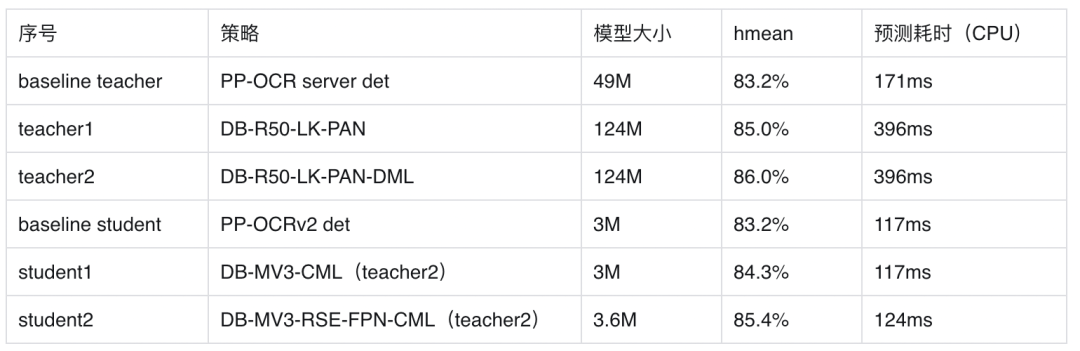

PP-OCRv3检测模块对PP-OCRv2中的CML(CollaborativeMutual Learning) 协同互学习文本检测蒸馏策略进行了升级Xstar。如下图所示,CML的核心思想结合了传统的Teacher指导Student的标准蒸馏与Students网络之间的DML互学习,可以让Students网络互学习的同时,Teacher网络予以指导。PP-OCRv3分别针对教师模型和学生模型进行进一步效果优化。其中,在对教师模型优化时,提出了大感受野的PAN结构LK-PAN和引入了DML(Deep MutualLearning)蒸馏策略;在对学生模型优化时,提出了残差注意力机制的FPN结构RSE-FPN。消融实验如下表所示。

测试环境:Intel Gold 6148 CPUXstar,预测时开启MKLDNN加速

(1)LK-PAN:大感受野的PAN结构

LK-PAN (Large Kernel PAN) 是一个具有更大感受野的轻量级PAN结构,核心是将PAN结构的path augmentation中卷积核从3*3改为9*9Xstar。通过增大卷积核,提升特征图每个位置覆盖的感受野,更容易检测大字体的文字以及极端长宽比的文字。使用LK-PAN结构,可以将教师模型的hmean从83.2%提升到85.0%。

(2)DML:教师模型互学习策略

DML 互学习蒸馏方法,通过两个结构相同的模型互相学习,可以有效提升文本检测模型的精度Xstar。教师模型采用DML策略, hmean从85%提升到86%。将PP-OCRv2中CML的教师模型更新为上述更高精度的教师模型,学生模型的hmean可以进一步从83.2%提升到84.3%。

(3)RSE-FPN:残差注意力机制的FPN结构

RSE-FPN(ResidualSqueeze-and-Excitation FPN)引入残差结构和通道注意力结构,将FPN中的卷积层更换为带有残差结构的通道注意力结构的RSEConv层,进一步提升特征图的表征能力Xstar。进一步将PP-OCRv2中CML的学生模型的FPN结构更新为RSE-FPN,学生模型的hmean可以进一步从84.3%提升到85.4%。

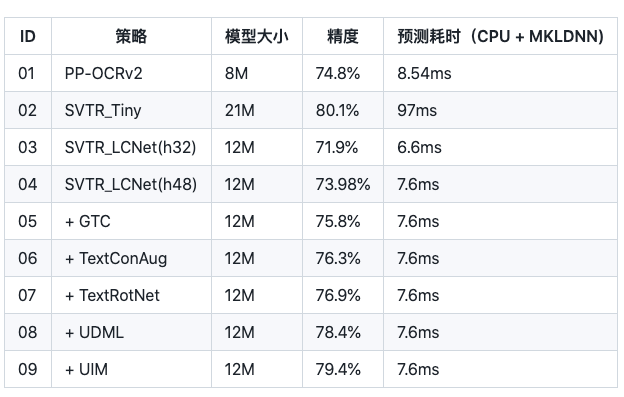

PP-OCRv3的识别模块是基于文本识别算法SVTR优化Xstar。SVTR不再采用RNN结构,通过引入Transformers结构更加有效地挖掘文本行图像的上下文信息,从而提升文本识别能力。直接将PP-OCRv2的识别模型,替换成SVTR_Tiny,识别准确率从74.8%提升到80.1%(+5.3%),但是预测速度慢了将近11倍,CPU上预测一条文本行,将近100ms。因此,如下图所示,PP-OCRv3采用如下6个优化策略进行识别模型加速,消融实验如下表所示:

注:测试速度时,实验01-03输入图片尺寸均为(3,32,320),04-08输入图片尺寸均为(3,48,320)Xstar。在实际预测时,图像为变长输入,速度会有所变化。测试环境:Intel Gold 6148 CPU,预测时开启MKLDNN加速。

(1)SVTR_LCNet:轻量级文本识别网络

(2)GTC:Attention指导CTC训练策略

(3)TextConAug:挖掘文字上下文信息的数据增广策略

(4)TextRotNet:自监督的预训练模型

(5)UDML:联合互学习策略

(6)UIM:无标注数据挖掘方案

经过上述文本检测和文本识别9个方面的优化,最终PP-OCRv3在速度可比情况下,在中文场景端到端Hmean指标相比于PP-OCRv2提升5%,效果大幅提升Xstar。具体指标如下表所示:

在英文数字场景Xstar,基于PP-OCRv3单独训练的英文数字模型,相比于PP-OCRv2的英文数字模型提升11%,如下表所示:

“全赖Google”Xstar,开源作者撤下所有应用并宣布:我不会回来了 你把卖给我的软件开源了,我告你还被你反诉赔1000万? 遭弃用的Docker Desktop放大招:宣布支持Linux

觉得不错Xstar,请点个在看呀

评论